[ENGLISH BELOW] Trong những năm gần đây, ngành kỹ xảo hình ảnh (VFX) đang có sự chuyển mình rõ rệt nhờ sự hỗ trợ từ các công cụ trí tuệ nhân tạo (AI). Thay vì thực hiện các bước phức tạp như theo dõi chuyển động, tách nền đối tượng hay xử lý hậu kỳ một cách thủ công, AI giờ đây có thể giúp tự động hóa và tối ưu nhiều công đoạn. Điều này mở ra cơ hội ứng dụng rộng rãi hơn cho cả các dự án lớn và nhỏ trong ngành công nghiệp nội dung.

Vậy các công cụ AI đang được ứng dụng như thế nào trong quy trình thực hiện VFX, và chúng đem lại những lợi ích gì dành cho người sử dụng?

Nội dung bài viết

1. Trợ giúp từ AI cho quy trình VFX:

2. Những dự án nổi bật đã ứng dụng AI vào VFX:

3. Kết luận

1. Những trợ giúp từ AI cho quy trình VFX:

1.1 Phát hiện và theo dõi đối tượng (Object detection & tracking)

AI hiện đại sử dụng các mô hình học sâu kết hợp kỹ thuật ước lượng chuyển động để phân tích chuyển động trong từng khung hình. Về mặt lý thuyết, kỹ thuật này mô tả trường chuyển động của các điểm ảnh giữa hai khung hình, giúp xác định hướng và tốc độ di chuyển trong khi những mô hình như FlowNet 2.0 đã kết hợp mạng nơ‑ron để ước lượng chuyển động cực nhanh (lên đến 140 FPS) với độ chính xác ngang ngửa phương pháp cổ điển.

|

Theo Boris FX, tính năng này giúp tách nền và tạo chuyển động chỉ trong vài giây, thay vì mất hàng giờ nếu làm thủ công. Điều đó nghĩa là mỗi shot có thể được xử lý nhanh hơn gấp từ 10 đến 20 lần, giúp tiết kiệm đáng kể thời gian cho các studio VFX.

1.2. Nhận dạng khuôn mặt và capture chuyển động (Facial recognition & motion capture)

AI sử dụng công nghệ thị giác máy tính để theo dõi chuyển động khuôn mặt, cơ thể và tay từ video thông thường. Dữ liệu thu được sau đó được chuyển thành hệ xương (skeleton) và biểu cảm của nhân vật CG. Về lý thuyết, quá trình này dựa trên kỹ thuật ước lượng tư thế và hệ thống phân tích hoạt động cơ mặt nhằm mô phỏng biểu cảm một cách chính xác và tự nhiên.

|

Trong series Superman & Lois, Boxel Studio đã sử dụng giải pháp nắm bắt chuyển động không cần đánh dấu từ Autodesk Flow Studio (trước đây là Wonder Studio) để xử lý 134 cảnh quay trong vòng 6 tuần. Trước đó, với workflow truyền thống, mỗi shot tương đương mất khoảng 3 tuần, tức là nếu dùng phương pháp cũ, họ sẽ mất 3–6 lần thời gian so với kết quả đạt được bằng AI chỉ trong vài ngày.

1.3 Xử lý hình ảnh theo ngữ cảnh (Content-aware processing)

AI sử dụng các mô hình thông minh để phân tích nội dung trong từng vùng của hình ảnh, từ đó xác định đâu là nhân vật chính, đâu là nền. Nhờ đó, hệ thống có thể tự động xóa vật thể, thay nền, làm mượt hình ảnh hoặc tăng độ nét mà không cần chỉnh tay từng bước.

|

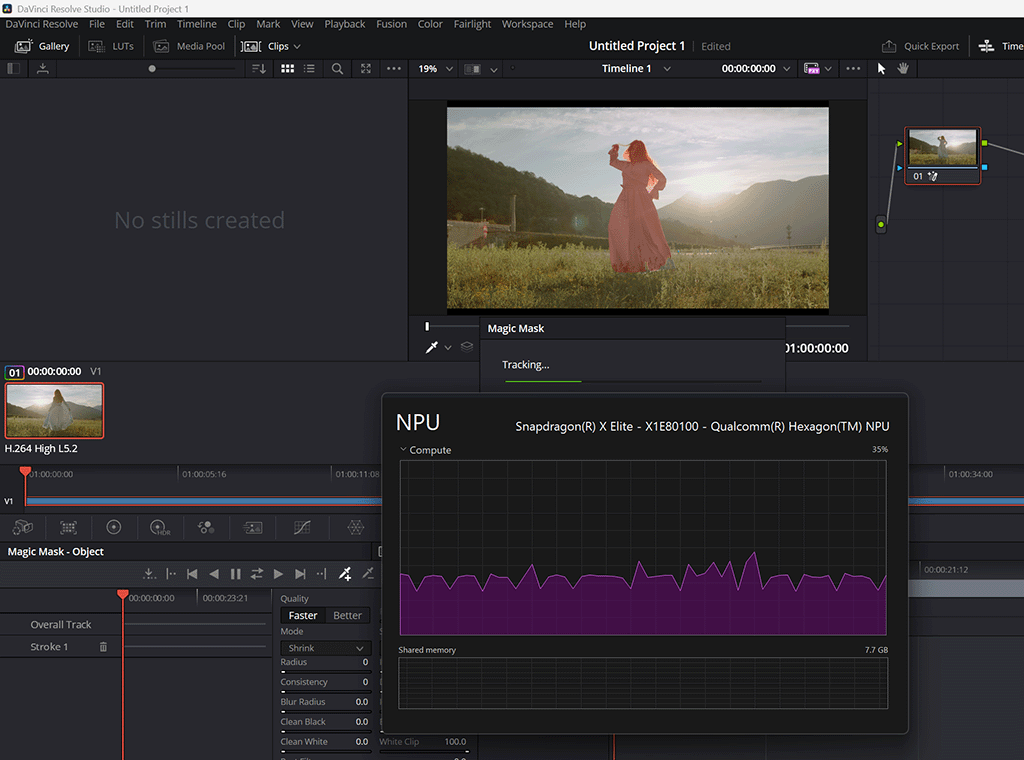

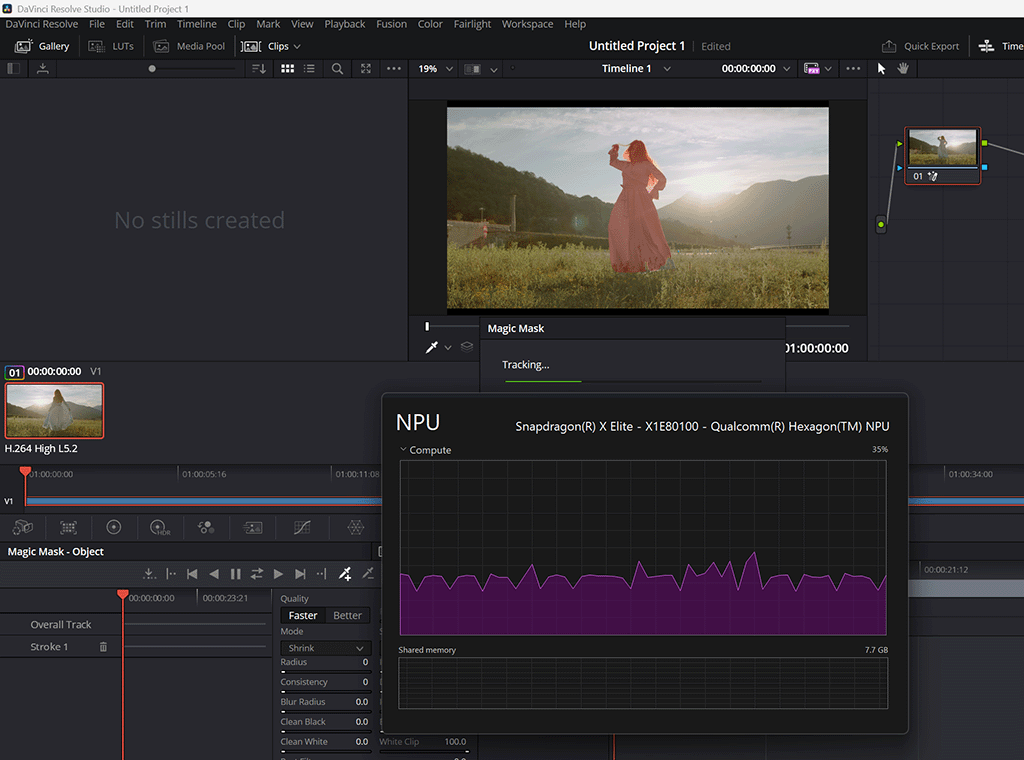

Trong DaVinci Resolve 20, các tính năng như Magic Mask 2 (kỹ thuật nhận diện và tách nền chủ thể) và UltraNR (kỹ thuật nhận diện và loại bỏ noise) cho phép nhận diện chủ thể và xử lý noise chỉ trong vài thao tác, thay vì mất hàng giờ thao tác thủ công. Điều này không chỉ rút ngắn thời gian hậu kỳ mà còn nâng cao chất lượng đầu ra một cách rõ rệt, đặc biệt trong các dự án cần xử lý nhanh và giữ tính thẩm mỹ cao.

1.4 Tổng hợp hình ảnh & compositing tự động

Generative AI sử dụng các mô hình như: tạo ảnh bằng cách khôi phục từ ảnh nhiễu và mô hình học sâu sinh dữ liệu theo ngữ cảnh để tạo hoặc kết hợp cảnh quay từ mô tả văn bản. Nhờ đó, những cảnh có yếu tố tưởng tượng, phức tạp về ánh sáng hay môi trường có thể được hình dung và dựng lên mà không cần bối cảnh thật. Công nghệ này đặc biệt hữu ích trong giai đoạn dựng cảnh thử và tổng hợp hình ảnh, giúp tiết kiệm thời gian và chi phí trong quá trình sản xuất VFX.

Dự án Ancestra kết hợp live‑action và Generative AI (Veo, Imagen, Gemini) để chuyển prompt văn bản thành cảnh nội tâm một cách nhanh chóng. Trước đây, nếu dựng cảnh phức tạp như hành trình qua cơ thể người, cần mất vài tuần với kỹ xảo thủ công. Nhưng với AI, mỗi đoạn clip tương tự được tạo ra trong vài phút, giúp toàn bộ film 12–15 phút hoàn thiện trong vài tuần, thay vì kéo dài nhiều tháng như thông thường.

-

2. Những dự án nổi bật đã ứng dụng AI vào VFX:

Toys “R” Us

|

Với chiến dịch quảng cáo này, AI Sora chịu trách nhiệm tạo ra 80–85% khung cảnh và nội dung chẳng hạn như môi trường, nhân vật như cậu bé Charles Lazarus và chú hươu Geoffrey, chỉ bằng cách nhập prompt mô tả chi tiết đến từng shot.

Phần còn lại cần khoảng 20 người trong đội hậu kỳ để ghép cảnh, chỉnh màu và xử lý lỗi hình ảnh. Nhờ đó, thời gian và chi phí sản xuất được tiết kiệm đáng kể, mà vẫn đảm bảo chất lượng hình ảnh, đúng yêu cầu về thương hiệu và cảm xúc.

Pixar - Elemental

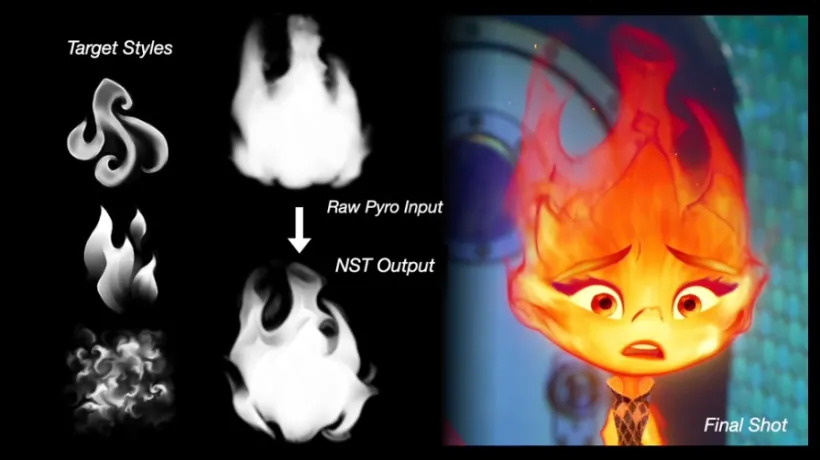

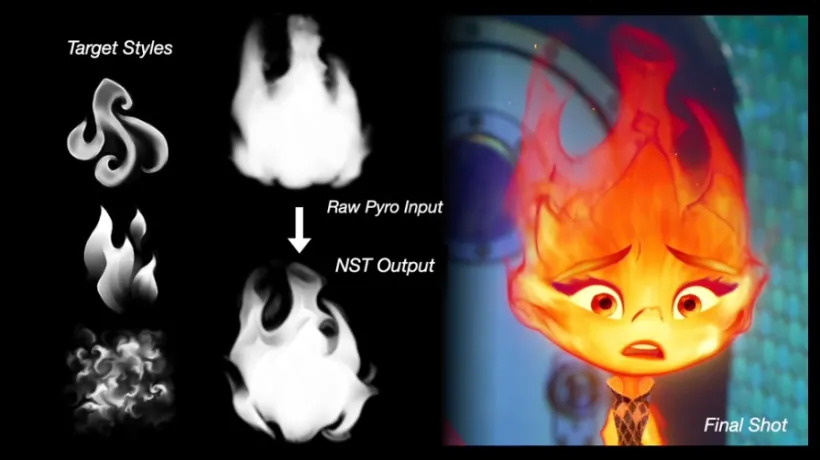

Pixar đã sử dụng kỹ thuật Neural Style Transfer (NST) trong lĩnh vực thị giác máy tính và kỹ thuật học sâu (deep learning) để xử lý hiệu ứng lửa trong phim Elemental, giúp tạo ra những khung hình vừa sống động vừa mang dấu ấn thẩm mỹ riêng.

|

Thay vì mô phỏng hoàn toàn bằng kỹ thuật truyền thống, họ áp dụng NST để chồng các họa tiết nghệ thuật lên ngọn lửa của nhân vật Ember. Cách tiếp cận này không chỉ mang lại phong cách hình ảnh độc đáo mà còn giúp Pixar tăng tốc độ render lên tới 20 lần nhờ tối ưu GPU và quy trình xử lý nội bộ.

EFFEX Studio

|

Trong một dự án khoa học viễn tưởng của EFFEX Studio, phần mềm Wonder Studio (thuộc Wonder Dynamics) đã được sử dụng để tự động theo dõi chuyển động, phân tích ánh sáng và kết hợp góc quay từ video gốc. Sau đó, trí tuệ nhân tạo tự thêm nhân vật ảo vào, đồng thời xử lý hoàn chỉnh các yếu tố như bóng, phản chiếu và sự tương tác với khung cảnh xung quanh. Nhờ công nghệ này, 12 cảnh quay phức tạp đã được hoàn thiện chỉ trong một ngày, trong khi cách làm thông thường có thể mất cả tuần. Phương pháp này giúp rút ngắn tới 80% thời gian thực hiện, giảm bớt chi phí phần mềm và nhân công.

3. Kết luận:

AI đang dần trở thành một nhân tố góp phần nâng cao hiệu suất và mở rộng biên độ sáng tạo trong VFX. Dù vẫn cần sự dẫn dắt từ bàn tay con người, AI đang chứng minh vai trò như một đối tác công nghệ đắc lực trong các khâu kỹ thuật quan trọng. Trong tương lai, sự phối hợp linh hoạt giữa trí tuệ nhân tạo và tư duy nghệ thuật hứa hẹn sẽ tạo nên những bước tiến đột phá cho ngành công nghiệp hình ảnh.

Xem thêm

Seedance 1.0: Công cụ tạo AI Video được Bytedance tuyên bố vượt trội nhất đến hiện tại

Tìm hiểu AI Video Tools Gen-4 và Veo-3: Đâu là lựa chọn phù hợp cho doanh nghiệp?

Runway Gen-4: Bước Đột Phá trong Sáng Tạo Video AI

TRÒN

------------------

In recent years, the visual effects (VFX) industry has undergone a significant transformation thanks to the rise of artificial intelligence (AI). Complex processes like motion tracking, background separation, and post-production—once done manually—can now be automated and optimized with AI. This breakthrough opens new doors for both large-scale productions and smaller creative projects.

So how exactly is AI being used in the VFX workflow? And what benefits does it bring to creators?

Content Articles:

1. How AI supports the VFX process:

2. Notable projects applying AI in VFX

3. Conclusion

1. How AI supports the VFX process:

1.1 Object detection & tracking

Modern AI models combine deep learning with motion estimation techniques to analyze movement across video frames. In simple terms, they calculate how each pixel moves from one frame to the next—helping determine the direction and speed of motion. Advanced neural network models like FlowNet 2.0 can now estimate this at up to 140 FPS with accuracy comparable to traditional methods.

|

According to Boris FX, this allows background separation and motion generation in just seconds—tasks that previously took hours to complete manually. Each shot can now be processed 10 to 20 times faster, dramatically reducing production time for VFX studios.

1.2. Facial recognition & motion capture

AI-powered computer vision tools can track facial expressions, body movement, and hand gestures from standard video footage. This data is then converted into a skeletal structure and emotional expressions for CG characters. In theory, the system relies on pose estimation and facial analysis techniques to recreate lifelike expressions.

|

In the TV series Superman & Lois, Boxel Studio used Autodesk Flow Studio (formerly Wonder Studio) for markerless motion capture. They completed 134 shots in just six weeks. Previously, using traditional workflows, each shot could take up to three weeks—meaning the AI approach saved 3–6 times the time.

1.3 Content-aware processing

AI tools analyze specific regions in an image to identify the main subject and background. Based on this understanding, they can automatically remove objects, replace backgrounds, smooth out edges, or enhance sharpness—without manual adjustments.

|

In DaVinci Resolve 20, features like Magic Mask 2 (for subject separation) and UltraNR (for noise reduction) allow editors to process shots in just a few clicks. What used to take hours of manual work can now be done in minutes—streamlining post-production while improving output quality, especially in fast-turnaround projects with high visual standards.

1.4 Automated Compositing & Scene Generation

Generative AI models use two main techniques: one restores images from visual noise, and the other generates scenes from text prompts. These models make it possible to visualize and build imaginative environments—such as fantastical lighting or surreal landscapes—without relying on physical sets.

This is especially useful in pre-visualization and scene composition, cutting down both production time and costs.

For example, the project Ancestra blended live-action with Generative AI tools like Veo, Imagen, and Gemini to turn text prompts into immersive, emotional scenes. Creating complex visuals like a journey through the human body once took weeks of manual effects work—but with AI, each clip can be produced in minutes. As a result, the full 12–15-minute film was completed in just a few weeks instead of several months.

-

2. Notable Projects Using AI in VFX:

Toys “R” Us

|

In this campaign, AI tool Sora generated around 80–85% of the scenes and content—including settings and characters like young Charles Lazarus and the iconic giraffe Geoffrey—based solely on detailed text prompts.

A team of 20 artists handled final steps like compositing, color grading, and error correction. This AI-human collaboration dramatically reduced production time and costs while still achieving brand and emotional impact.

Pixar - Elemental

Pixar integrated Neural Style Transfer (NST)—a technique from computer vision and deep learning—into the fire effects for Elemental. Rather than relying solely on traditional animation, they used NST to overlay artistic textures on Ember’s flames.

|

This approach not only created a distinctive visual style but also accelerated rendering speeds by up to 20 times thanks to GPU and pipeline optimizations.

EFFEX Studio

|

In a sci-fi short by EFFEX Studio, Wonder Studio (by Wonder Dynamics) was used to automate movement tracking, lighting analysis, and camera angle matching from live-action footage. AI then inserted a CG character, handling all shadows, reflections, and environmental interactions seamlessly.

With this method, 12 complex scenes were completed in just one day—where traditional methods might take a week. The studio cut up to 80% of the production time and significantly reduced software and labor costs.

3. Conclusion:

AI is quickly becoming an integral part of the VFX pipeline—boosting efficiency while expanding creative possibilities. While human direction remains essential, AI now acts as a powerful creative partner in many technical stages. In the near future, the collaboration between artificial intelligence and human artistry is poised to reshape the landscape of visual storytelling.

TRÒN